회사에서 바로 쓰는 업무자동화 AI 에이전트 (w. n8n, LangGraph)

제이쓴

인공지능, AI, 에이전트… 뭔가 대단해 보이지만, 막상 해보면 생각보다 별 거 아닙니다. 그래서 간단한 기능을 직접 구현해보는 것이 중요합니다. 회사에서 실제로 쓸 수 있는 실용적인 프로젝트를 통해, 다양한 유즈케이스를 직접 경험하고, AI 에이전트를 활용하고 응용하는 방법까지 배워봅니다.

초급

n8n, 인공지능(AI), LangChain

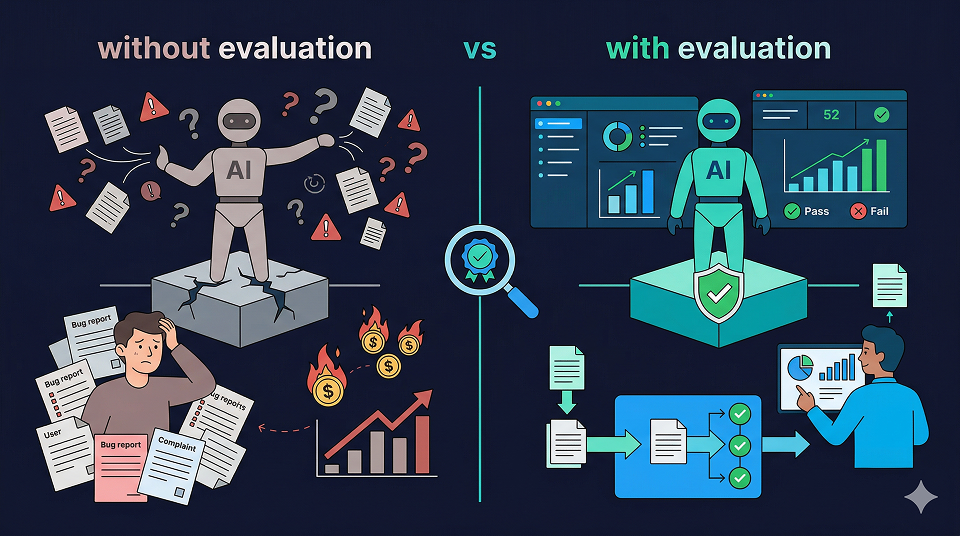

AI 에이전트, 배포할 때마다 불안하신가요? 국내 대기업/해외 빅테크 경험을 바탕으로, LangSmith를 활용해 에이전트 품질을 체계적으로 측정하고 개선하는 방법을 알려드립니다.

12명 이 수강하고 있어요.

난이도 중급이상

수강기한 무제한

AI 에이전트 특화 평가 방법론과 실무 노하우

"감"이 아닌 "데이터" 기반의 의사결정 체계 구축

개발 및 테스트 비용의 획기적인 절감

실제 서비스 운영 시 발생하는 에러 해결 및 디버깅 기술

프롬프트 하나 바꿨을 뿐인데, 잘 동작하던 기능이 갑자기 버벅거려요.

최신 모델이 더 똑똑하다길래 업그레이드했는데, 전보다 성능이 떨어진 것 같아요.

기능을 개선했는데, 어디까지 테스트해야 안심하고 배포할 수 있을지 모르겠어요.

배포를 앞두고 에이전트 성능을 물어보시는 팀장님에게 어떻게 설명해야 할지 막막해요.

우리가 망설이는 원인은 하나입니다.

프롬프트 · 모델 · 로직을 변경했을 때

전체 성능이 정말 개선될 지 확신이 없다는 것

AI 에이전트는 일반적인 소프트웨어와 다른 특성을 가지고 있습니다.

같은 프롬프트를 입력하더라도 매번 결과가 달라지기 때문에, 한 번 결과가 좋았다고 항상 좋다는 보장이 없습니다.

에이전트가 다루는 문제는 하나의 정답이 없는 경우가 대부분입니다. 그래서 Pass/Fail 만으로는 품질을 잡을 수 없습니다.

에이전트는 프롬프트 수정, 모델 업데이트, 사용자 입력/패턴 변화 등으로 계속 변하기 때문에 지속적인 품질 확인이 필요합니다.

결국,

그래서 알려드리는

평가 프로세스에 맞춰 데이터셋 구축부터 에이전트 평가, 성능 비교까지

실무에 바로 적용할 수 있는 전 과정을 다룹니다.

AI로 도메인에 맞는 평가 데이터를 만드는 세 가지 방법을 학습합니다.

질문-정답 QA 데이터셋을 자동으로 생성

커스텀 프롬프트와 도구로 도메인에 맞는 데이터 생성

소규모 데이터를 대량의 데이터 셋으로 확장

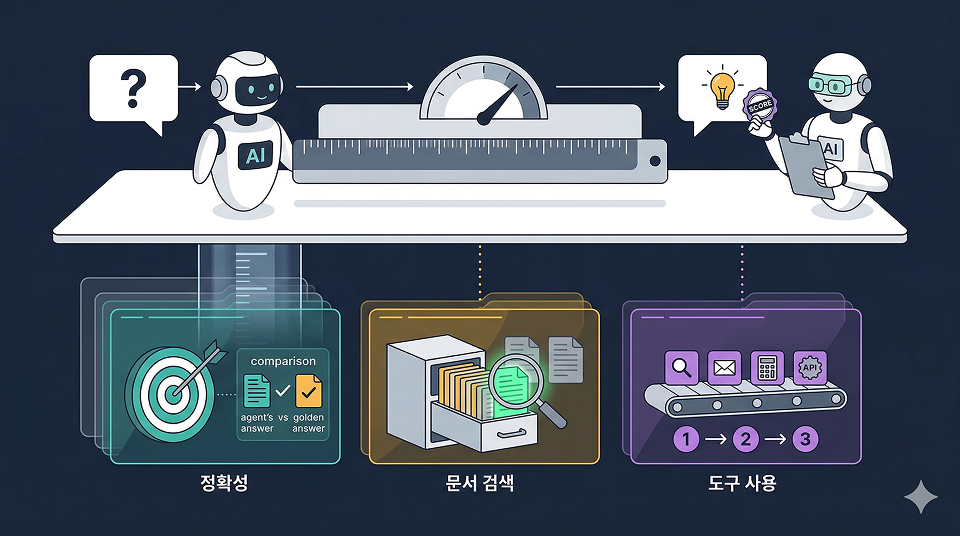

Anthropic, Google, Amazon이 채택한 방법으로 에이전트가 어디서 왜 실패했는지 검증하는 방법을 알려드립니다.

E2E는 최종 결과의 성공/실패를 알 수 있는 평가 방법입니다. 하지만 10~20단계를 거치는 복잡한 실무 에이전트에서는 Component 평가를 함께 써야 합니다. 각 단계를 검증하며 "검색이 문제인지, 도구 선택이 문제인지"를 정확히 짚어 효율적으로 디버깅할 수 있습니다.

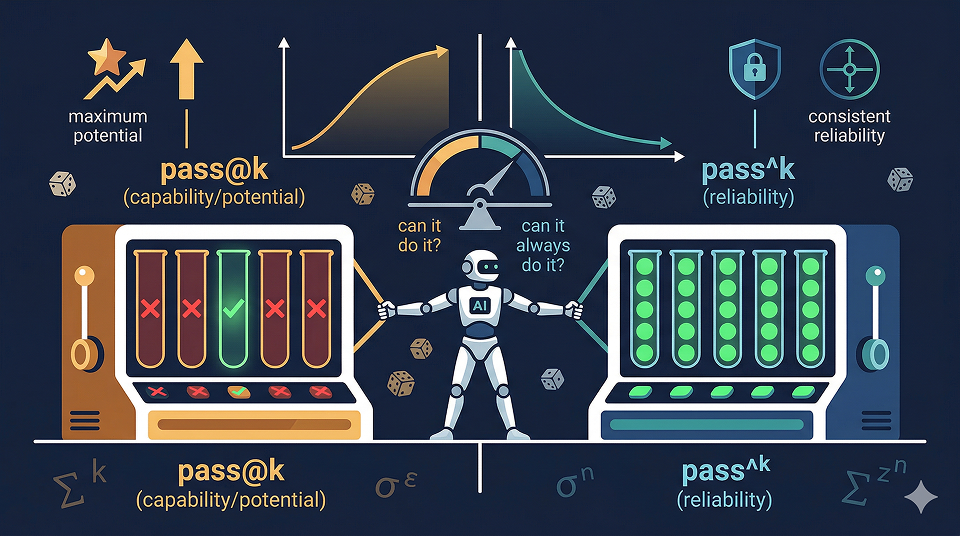

에이전트의 최대 성능과 일관성을 객관적으로 비교 · 평가할 수 있는 2가지 방법을 소개합니다.

에이전트가 낼 수 있는 최대의 성능을 확인하는 지표

이전트가 얼마나 일관되게 작동하는지 확인하는 지표

Section 1

AI 에이전트 평가의 정의와 필수적인 이유를 설명합니다. 데이터 기반의 의사결정 체계 구축을 통해 AI 서비스의 완성도를 높이고 개발 및 테스트 비용을 절감하는 방안을 탐구합니다.

Section 2

Golden Dataset을 생성하는 방법을 다룹니다. LangSmith 설정, 커스텀 에이전트 및 다양한 문서 유형을 활용한 데이터셋 구축 실습을 포함합니다.

Section 3

AI 에이전트의 성능을 측정하기 위한 평가 지표 설계를 학습합니다. End-to-End 평가 및 컴포넌트별 평가 방법을 통해 정확성, 문서 검색, 도구 사용의 효율성을 분석합니다.

Section 4

Pass@k와 Pass^k와 같은 고급 지표를 사용하여 에이전트의 최대 성능과 신뢰성을 수치적으로 분석하는 방법을 배웁니다. 이를 통해 에이전트의 잠재력과 안정성을 심층적으로 평가합니다.

모델 성능 향상을 위해 프롬프트를 수정할 때마다,

기존 기능이 예상치 못하게 오작동할까 봐 불안감을 느끼는 분

모델 업데이트 시, 서비스 전반의 안정성이 저하될까 봐,

명확한 평가 지표 없이 직관에 의존하여 의사결정하는 데 어려움을 겪는 분

AI 에이전트의 성능 개선 요구사항을 팀에 전달할 때,

'감'이 아닌 구체적인 데이터와 지표를 기반으로 소통하고 싶은 분

실습 환경

Python 3.13 이상 버전 설치가 필요합니다.

선수 지식 및 유의사항

Python 프로그래밍 기본 문법에 익숙해야 합니다.

LangChain + LangGraph 활용 에이전트 개발 경험이 있으신 분들께 적합합니다

LangChain 문법에 익숙하지 않으시다면 한시간으로 끝내는 LangChain 기본기↗️ 를 먼저 수강해주세요

LangGraph 문법에 익숙하지 않으시다면 LangGraph를 활용한 AI Agent 개발↗️ 을 먼저 수강해주세요

학습 자료

학습 대상은

누구일까요?

프롬프트를 한 줄 고칠 때마다, 다른 기능이 망가질까 봐 불안한 개발자

개발 팀과 소통할 때 '느낌'이 아닌 데이터와 지표를 바탕으로 의사결정을 내리고 싶은 기획자

기초를 넘어 실무 수준의 AI 에이전트를 개발하고 싶은 개발자

선수 지식,

필요할까요?

Python 필수

LangGraph 필수

17,960

명

수강생

1,358

개

수강평

514

개

답변

4.9

점

강의 평점

10

개

강의

FAANG Senior Software Engineer

(전) GS 그룹 AI Agent 플랫폼 개발/운영

(전) GS 그룹 DX BootCamp 멘토/코칭

(전) 시리즈 C AI 스타트업 테크리드

Stanford University Code in Place Python Instructor

네이버 부스트캠프 웹/모바일 멘토

네이버 클라우드 YouTube Channel presenter

혼자서도 척척 해내는 AI 에이전트 만들기 with 랭체인 & 랭그래프 저자

원티드 프리온보딩 프론트엔드/백엔드 챌린지 진행 (누적 6000+)

항해 AI 플러스코스 1기 코치

전체

18개 ∙ (3시간 16분)

얼리버드 할인 중

₩6,321

28%

₩69,300

지식공유자님의 다른 강의를 만나보세요!

같은 분야의 다른 강의를 만나보세요!